AIエージェントの損害、責任は誰がとる?

リスク恐れる日本企業

Source: Nikkei Online, 2026年3月9日 5:00

人工知能(AI)が自律的に作業をする「AIエージェント」により生じた損害の責任の曖昧さがリスクになっている。顧客対応や旅行予約などの作業を担うサービスが登場したものの、裁判所の判例の蓄積はなく、企業がひるむ一因といえる。政府の見解は整理の途上にある。

総務省と経済産業省は「AI事業者ガイドライン」の内容更新の検討を進めている。両省は月内に更新内容を固め、AIエージェントに関する記述を初めて盛り込む。

2025年12月にあった有識者会議で、理化学研究所の中川裕志・革新知能統合研究センターチームディレクターは「誤動作が発生した際の損害の問題は極めて重要な論点だ。誤った予約や購入により損害が発生する事態は今後、頻繁に生じると予想する」と指摘した。

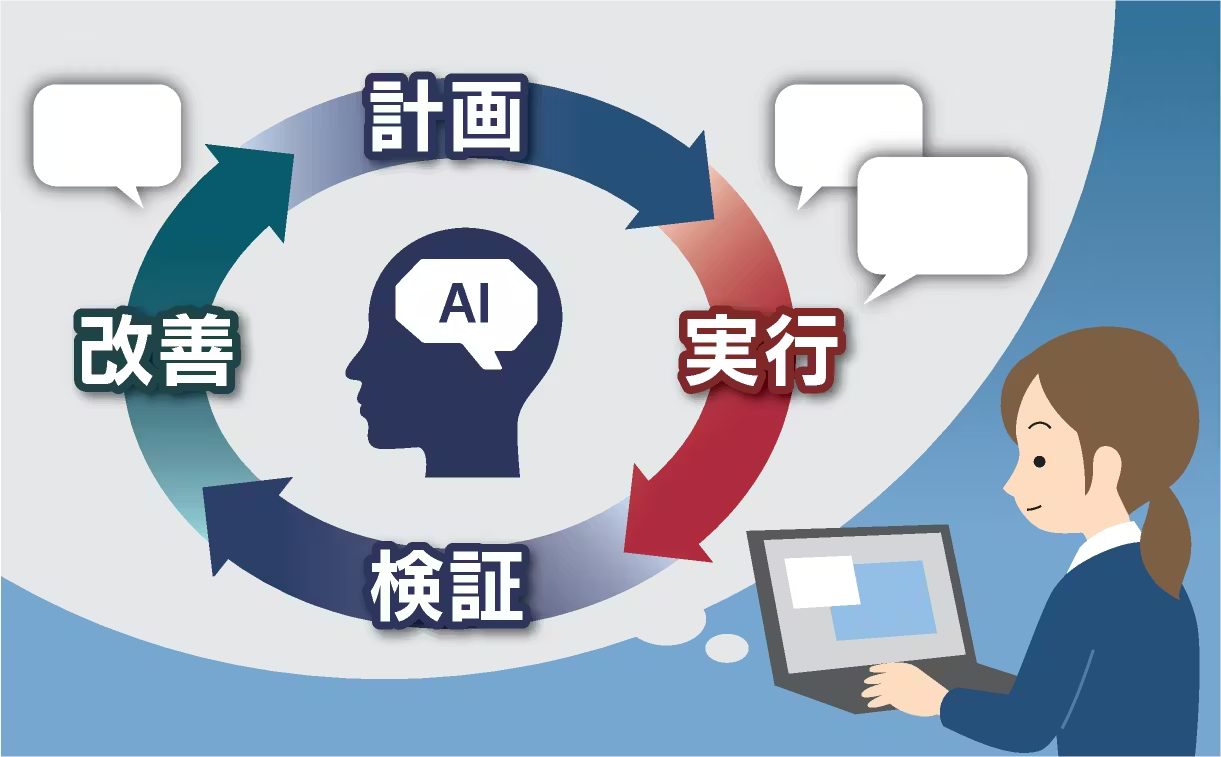

誤動作などのリスクを念頭に「人間の判断を必須とする仕組み」の導入を求める。重要なポイントで人間の判断が介在すれば適切な利用ができるとの考えがある。

生成AIの中でも特にAIエージェントは責任の所在が見通しにくい。技術進展により人間の判断や行動が介在していない場合、従来の民法上の過失判断が適用しにくい課題がある。

経産省はAI利用の民事責任の考え方を示す「手引」を今春にまとめる。手引案ではAIエージェントについて「個別技術やユースケース(どう使うか)に強く依存するため、当事者の責任を個別具体的に整理するのは現時点で困難」と記載した。

関係者は「問題意識はあるものの、色々な利活用の仕方がある中で行政が先に判断を示すのは難しい」と述べる。事後的に責任を評価する時にポイントとなる観点を示した。

AIが人の判断や行動を代替する場合、サービス提供企業に対して適正な業務プロセスやリスクを低減する運用の義務が生じる。論点として

- 「精度や安全性を満たしたAIシステムか、

- 必要な場面での人の関与を含めた業務プロセスを構築していたか」

- 「誤回答を踏まえた改善やAIによる回答であることの表示の要否」

アンダーソン・毛利・友常法律事務所の清水亘弁護士は「損害があった場合、現実的に可能な対策をしていない限りサービス提供企業に責任が生じ得る」と話す。企業は損害が生じる前提に立ち、AI同士の相互チェックや権限に制限を設ける仕組みなどで、リスクを抑える運用をする必要があると提起する。

経産省は所管する企業のAI導入を促すために「AIトランスフォーメーション室」を2月に設置した。課長・室長以上を中心に40人規模を併任している。

日本は米欧中に比べてAI導入が進んでいない。企業がためらう一因としてAIを巡る責任の曖昧さがあるとの指摘もある。リスクに敏感な日本企業に合わせて、国として本気でAI導入を進めるならば、予見性を高めてリスク対処の指針をどのように示すかは重要な論点になる。