GoogleのAI技術「TurboQuant」とは

データ圧縮、メモリー需要減る?

Source: Nikkei Online, 2026年3月28日 5:00

・どんな技術でどこが画期的か

・実現したら何ができるのか

・なぜ大手メモリー株が急落?

米グーグルが発表したAI(人工知能)関連のアルゴリズム(計算手法)に注目が集まっている。AIが回答を導き出す「推論」と呼ぶ工程に使うメモリー容量を6分の1に減らす技術だ。AI普及によって増え続ける半導体メモリーの需要動向に影響するとの見方も出ている。

処理性能を最大8倍に

グーグルの研究機関であるグーグルリサーチが24日、「TurboQuant(ターボクアント)」と名付けたアルゴリズムを発表した。推論の際に処理データを圧縮する技術で、メモリーの使用量を6分の1以下に減らせる。同じ計算基盤を使う場合には推論時の一部処理性能を最大8倍にできるという。

ターボクアントの論文は25年4月に査読前論文の投稿サイト上で公開されていた。論文が26年4月開催の国際学会に採択され、グーグルリサーチが自社ウェブサイトで詳細を改めて公開したことで注目を集めた。

応用先は多岐にわたる。AIが文章を生成する際には、文脈を短期記憶として保存・参照して回答文をつくる。文章が長くなるほど短期記憶のデータは膨大になる。このデータを特殊な技術で圧縮することで効率的に回答文を生成できる。

研究者らは論文内でターボクアントを「アクセラレーター・フレンドリー」(計算機に優しい)と評価した。AIの処理を担う画像処理半導体(GPU)など計算機の性能を発揮しやすくなるためだ。

データの圧縮技術はこれまでもあった。ただ圧縮するほどにAIの精度が低下する課題があった。ターボクアントはデータの変換を効率的にし、数学的な補正で計算精度を維持した。データの種類や形式によらず適用可能で、AIモデルにも依存しない。理論上は汎用的に使える手法といえる。

現時点ではターボクアントを実際のサービスに応用するには、さらなる研究開発が必要だ。実現すれば、高度な推論作業をメモリー容量の限られる機器でこなしたり、高精度の検索サービスにつなげたりできる。

半導体メモリー株の波乱要因に

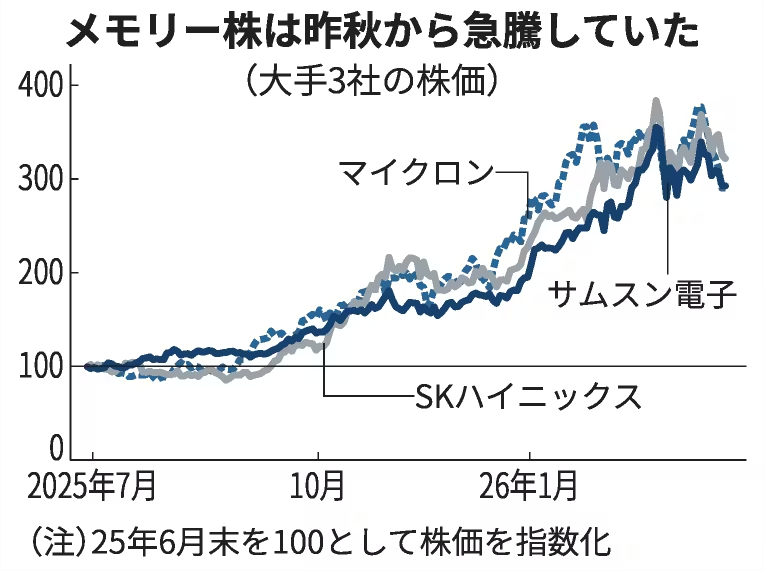

AI普及に伴って短期記憶を担う広帯域メモリー(HBM)の需要は急増してきた。韓国SKハイニックスや韓国サムスン電子、米マイクロン・テクノロジーの半導体メーカーが供給しきれずに一般的なメモリー不足にも波及し、パソコンなど最終製品の価格高騰を招いてきた。

グーグルが開発したデータ圧縮技術が広く使われるようになれば、半導体メモリーの搭載量は想定より少なくなる可能性もある。この連想が株式市場で広まったことで、半導体メモリー大手の株価はグーグルリサーチの発表後に約10%下げた。

米クラウドサービス大手クラウドフレアのマシュー・プリンス最高経営責任者(CEO)は「この技術はDeepSeek(ディープシーク)のようなものだ」とX(旧ツイッター)に投稿した。中国のAI新興企業ディープシークが低コストのAIモデルを発表してAI関連銘柄の株価が一斉に下落した2025年1月を想起させると説明した。

ディープシーク・ショックは結果的に一時的なもので、米エヌビディアなどAI関連株はその後も最高値を更新した。半導体メモリー株は過去6カ月で2倍程度に上昇しており、利益確定売りに押された側面もある。グーグルの新技術がAIの推論を変えるのかを株式市場も注視している。

(江口良輔、杉山翔吾)